一、海量数据处理与存储概述

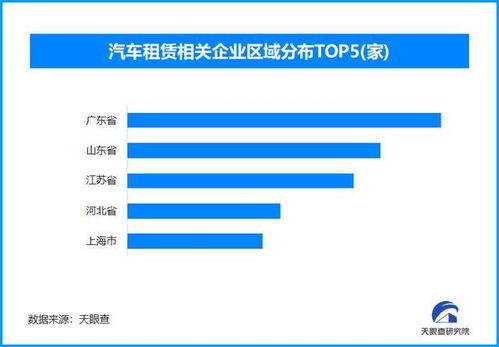

随着数字化时代的到来,数据量呈爆炸式增长,企业、科研机构及政府部门纷纷面临海量数据(Big Data)的高效处理与存储需求。海量数据通常具有“4V”特征,即数据量巨大(Volume)、数据类型多样(Variety)、数据产生速度快(Velocity)以及数据价值密度低(Value)。

二、数据处理与存储的关键技术

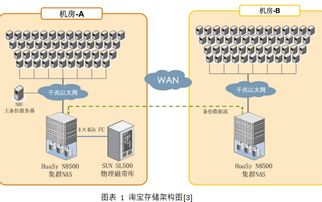

- 分布式存储系统:如Hadoop HDFS、Google File System(GFS)等,通过将数据分散存储在多个节点上,实现高可用性和扩展性。

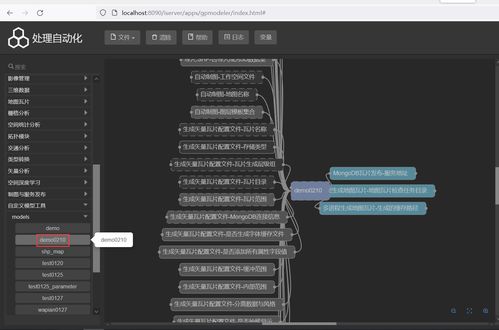

- 分布式计算框架:包括MapReduce、Spark和Flink等,支持并行处理海量数据,提高处理效率。

- 数据库技术:传统关系型数据库(如MySQL)扩展性有限,因此NoSQL数据库(如MongoDB、Cassandra)和NewSQL数据库(如Google Spanner)兴起,适用于非结构化或半结构化数据存储。

- 云存储服务:AWS S3、阿里云OSS等提供弹性、可扩展的存储方案,降低企业自建基础设施的成本。

三、数据处理与存储的挑战

- 数据安全与隐私:海量数据包含敏感信息,需加密、访问控制及合规性管理。

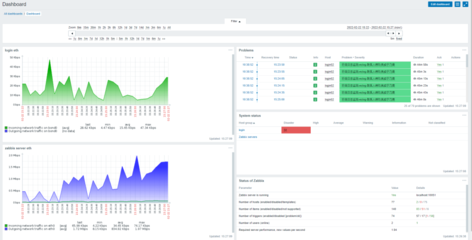

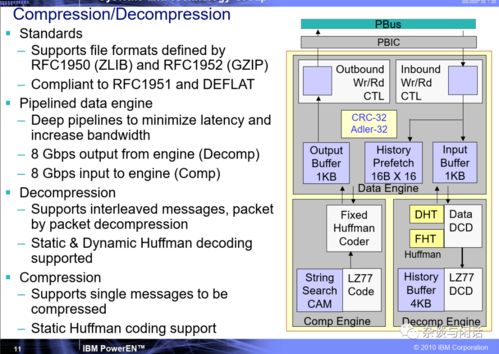

- 性能瓶颈:随着数据量增长,I/O延迟和网络带宽可能成为瓶颈,需优化数据分区和缓存策略。

- 成本控制:存储和计算资源消耗巨大,企业需平衡性能与成本,采用分层存储(如冷热数据分离)。

- 数据一致性:在分布式环境中,确保数据的一致性和完整性是难点。

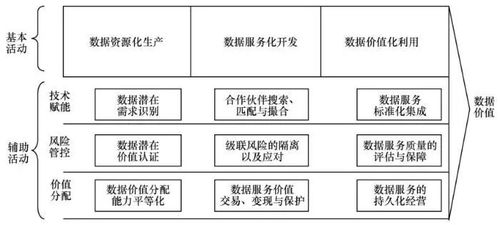

四、数据处理和存储支持服务

- 咨询与规划服务:专业团队提供数据架构设计、技术选型和实施路线图,帮助客户根据业务需求定制方案。

- 实施与集成服务:包括系统部署、数据迁移和与现有系统的集成,确保平滑过渡。

- 运维与监控服务:提供7x24监控、性能调优、备份与恢复,保障系统稳定运行。

- 培训与支持:为用户提供技术培训、文档和社区支持,提升团队自主能力。

- 云服务支持:主流云厂商(如AWS、Azure、阿里云)提供一站式数据处理和存储服务,包括数据湖、数据仓库(如Snowflake)和AI工具集成。

结论:海量数据处理与存储是现代数据驱动型业务的核心。通过采用先进技术和专业支持服务,组织可以有效应对挑战,释放数据价值,推动创新和增长。随着AI和边缘计算的发展,这一领域将持续演进,需要不断调研和优化。